兰德报告:机器时代的威慑,AI如何改变未来战争

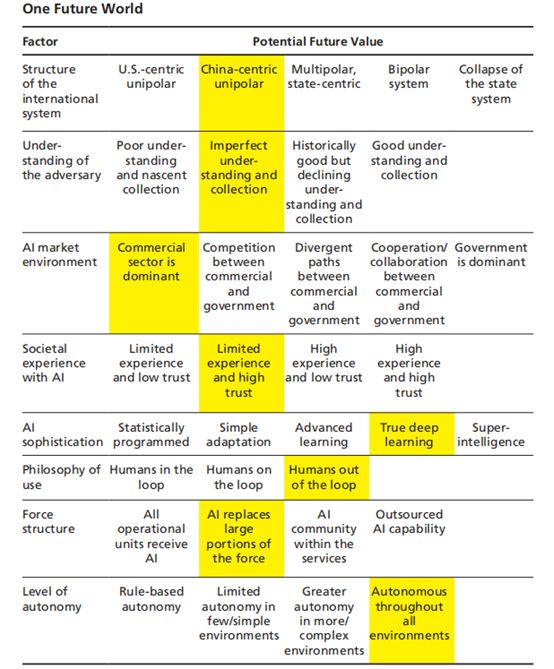

2020年1月,兰德发布了题为《Deterrence in the Age of Thinking Machines》(思维机器时代的威慑)的研究报告,分析了会思考的机器人(Thinking Machine,人工智能)如何改变未来战争。在报告中,研究人员讨论了威慑的关键概念,给出了人工智能和自主系统的简要背景,确定了随着人工智能系统的使用可能会对威慑和升级带来影响的关键因素,呈现了多个国家使用人工智能和先进自主系统进行对抗的未来战争场景,给出了这些技术对威胁和升级带来的潜在影响,并确定了未来的研究领域。

该报告研究并尝试回答以下4个问题:

- 将具有思维的机器人和自主系统加入到各国表明使用武力及其潜在后果的实践中,会产生什么影响?

- 当能够以机器的速度做出决策,同时由不危及使用国公民生命的力量执行时(比如机器人),威慑和升级会发生什么情况?

- 这些能力的增强会怎么样对威慑带来影响?

- 有哪些潜在的误判和意外的后果?

文章 仅供参考,观点不代表本机构立场。

一、概 述

人工智能和自主系统有改变未来战争的巨大潜力。随着战场上无人系统的使用、商业级AI取得的突破、许多国家将AI和自主系统应用于军事的兴趣,都使得人工智能和自主系统有望广泛应用于未来战争中。

二、人工智能与自主系统的兵棋推演

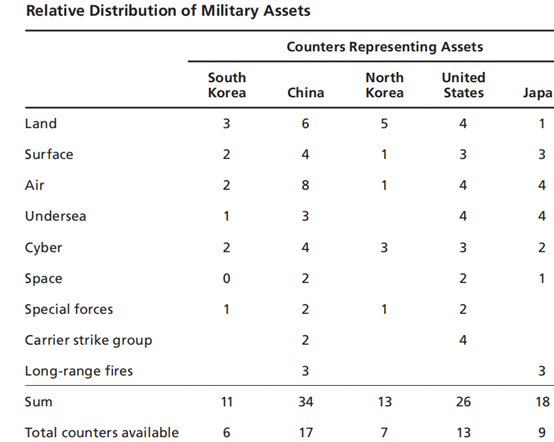

该主题研究的核心是一场兵棋推演,其中涉及美国、中国、日本、韩国和朝鲜等国家。在未来这些国家将人工智能和自主系统应用于战争场景中,中国是一方,而美、日、韩是与中国对抗的另一方联盟。该战争场景中,中国是全球大国,美国、日本和韩国仍然是与中国对抗的盟友。推演的目的不是为测试或发现使用这些技术的玩家如何与其他人抗衡,而是在操作框架中进行有条理的对话,讨论人工智能和自主技术如何随着事件的发展影响局势升级和威慑方式。

以下为推演假设(推演过程中,中国用“Z国”代替):

兵棋推演始于Z国试图对该地区实施更大的控制,美国和日本抵制这一企图。推演在几个方面进行了冲突升级,先是无人系统之间的冲突,最终演变成Z美两国军事人员被杀的冲突。美国和日本进行联合演习,故意挑衅Z国。为了对日本某些港口实施封锁,Z国采取了逐步升级的步骤,宣布进行无限制的潜艇战争,并击沉了一艘日本无人货船。美国和日本的反潜战装备随后击沉了一艘Z国载人潜水艇,这是该推演场景中的第一艘载人潜水艇。美国和日本在这一点上无法缓和局势。Z国以导弹袭击美国和日本的舰队作为报复,也造成了人员伤亡。推演结束时,危机仍在升级。

三、兵棋推演的相关发现

与无人系统相比,载人系统可能更有利于威慑。在兵棋推演中,美国和日本的系统更多地使用的是无人系统,而中国有很多的载人平台。由于中国载人系统平台上存在人员,使得美日两国在使用武力时更加犹豫,并经常将寻找方案以避免引发进一步升级的责任推到美日身上。

用无人系统取代载人系统可能并不会降低安全承诺。尽管在威慑程度方面,载人系统可能比无人系统要好,但用无人系统取代载人系统并不总是被视为美国减少对该地区盟国承诺的标志。

自主系统的加速使用确实导致了战争的意外升级。设置为自主模式的系统对人类其实并不打算使用武力的情况,可能会意外的作出使用武力的反应。

距离仍然非常重要。人工智能在决策中的存在,创造了混淆玩家和将不确定性插入动态的可能性,参与推演的国家在不同层次上混合了不同类型的的人机架构,且玩家可能显著高估对手在不可观察领域的现代化程度,比如人工智能。

四、对威慑的影响

自主和无人系统会影响延伸性威慑以及向盟国兑现承诺的能力。在兵棋推演中,盟国并不认为用机器人取代美军是承诺减少的表现,但情况并非总是如此。如果盟国认为自主和无人系统更有能力,或者他们认为美国领导人更可能使用自主系统,那么自主系统可以提高美国常规、扩大威慑的可信度。另一方面,盟国可能会把美国对无人系统的依赖看作是不愿意在与对手的对抗中让美国的生命处于危险之中。这可能会降低美国向盟国保证的能力。

广泛的人工智能和自主系统可能导致意外的升级和危机不稳定。以机器速度做出的决定也有可能使危机以机器的速度升级。在旷日持久的危机和冲突中,各方可能有强烈的动机尽早广泛地使用自主系统,以获得军事方面的优势。这就增加了首次打击不稳定的可能性。人工智能和自主系统也有可能会降低对手之间的战略稳定性,并进一步扩大使用武力的可能,因为这些系统会降低军事人员的风险。美国和中国之间的自主系统军备竞赛已经迫在眉睫,这可能会加剧不稳定的情况。

人类与智能代理的不同组合可能会影响两者之间的升级动态。在兵棋推演中,美国和日本军队走上了一条主要使用无人系统和有人控制的道路,而中国军队则使用由机器控制的载人系统。这就形成了一种动态,其中美国和日本由于不愿意杀害中国人曾多次尝试解除危机,但中方似乎并不觉得有必要解除危机。

机器在理解人类威慑性方面可能会更差。人工智能正被积极用于创造战术和作战优势,这可能会误解对手尝试解除危机的信号,和避免进一步升级或主动解除危机的情况。

传统的威慑主要是关于人类试图了解其他人类,而在这个智能的新时代,威慑涉及到许多其他途径的理解。人类不仅必须了解敌手,还必须充分了解自己的(智能)机器和敌手的(智能)机器。同时,机器还必须准确地理解友军、敌军和敌军的(智能)机器。这些其他途径的理解可能会带来误解和误判的可能性。随着时间的推移,持续的现代化意味着国家使用的系统将可能 是新系统和遗留系统的混合体,这可能会使人们难以理解军队中全部的人机交互。

在过去,自动系统经常会有无意中与友军或平民目标交战的案例,这可能会带来一些更先进系统的技术事故或故障的质疑。

军事自主系统并不是一个新的概念,地雷、鱼雷、方阵反导系统和宙斯盾武器系统等自主系统的交战也不鲜见。在许多过去的案例中,人和系统识别错目标是一个常见问题。人工智能有可能提高目标识别率,减少这种误差。在与更复杂的系统进行交互时产生的人类错误可能会带来一些新的非故意的接触。

人工智能和自主系统有可能会对威慑带来潜在的巨大影响。机器决策的速度、机器决策与 人工理解的差异、不同国家是否愿意使用自主系统、在该领域缺乏经验、以及在相关领域能力的持续发展都是可能会产生影响的因素。当前的规划和发展还跟不上处理这些新技术带来的升级问题的步伐。

五、未来研究方向

进一步研究威慑理论和其他框架,明确考虑人工智能和自主系统的潜在影响。为了成功管理预期的威慑活动和避免非预期的升级活动,非常有必要进行一些其他的思考。阻止人工智能和自主系统向军事领域应用的扩展是不可能的,所以在执行防御政策时,需要将其影响纳入考虑范围。在核威慑方面已经做了很多工作,因此研究人员建议:

评估新系统的升级潜力。研究人员建议对提出的人工智能实现方案进行系统级的评估,以评估在其设计、开发、测试或使用中应考虑的所有升级影响。其中既包括用来训练算法的数据,也包括在测试后对系统进行建议的检查以监视现场的行为,以及将系统集成到人员和其他机器的流程中,以更好地管理可能发生的意外升级。

评估新作战理念的升级潜力。除了了解在系统层会发生什么外,还需要了解AI赋能的决策过程如何处理决策,以及使用AI和自主系统的作战概念是否会导致错误计算或引发意外升级。给定的概念是否允许降级?怎么用?给定的作战概念本质上是否更具有升级性,或提供更多的作战优势?

作战和战略层面的其他战争场景。兵棋推演对于更好地理解意外的后果来说是一个特别有用的工具。报告中,研究人员探讨了在一个地理区域范围内,包含一周的活动的作战级推演。具有更多场景、更多对手和盟友的推演可能会得出不同的观点。在更大时间范围内进行战略层面的推演可能会引发升级和军备竞赛的不稳定性。

进一步研究对手和盟友的自主系统及其对自主系统的使用理念。威慑和保证不仅仅是要了解自己所拥有的能力,也涉及对对手和盟军能力的了解。知己知彼,百战不殆,对双方的人工智能和自主系统以及使用理念的了解是非常重要的。这些信息有望改善与盟国的互操作性,使美国的规划者可以更好地预测对手的决策周期。

增加与对手和盟国的透明度。在冷战期间,美国、盟国和其他合作过的国家需要考虑开发新的信号和机制来管理升级的信号和机制。军队如何构造和使用这些系统的透明度可能有助于更好的沟通、减少误解和误判。

(全文完)

兰德发布《思维机器时代的威慑》报告

作者:YUNA HUH WONG, JOHN M. YURCHAK, ROBERT W. BUTTON, AARON FRANK, BURGESS LAIRD, OSONDE A. OSOBA, RANDALL STEEB, BENJAMIN N. HARRIS, SEBASTIAN JOON BAE

发布时间:2020年 1月

编译:学术plus 张涛

报告下载地址:

https://www.rand.org/content/dam/rand/pubs/research_reports/RR2700/RR2797/RAND_RR2797.pdf

版权声明:本站原创和会员推荐转载文章,仅供学习交流使用,不会用于任何商业用途,转载本站文章请注明来源、原文链接和作者,否则产生的任何版权纠纷与本站无关,如果有文章侵犯到原作者的权益,请您与我们联系删除或者进行授权,联系邮箱:service@datagold.com.cn。